چکیده

در عصر دیجیتال امروز، سازمانها با حجم عظیمی از دادههای تولیدشده در لحظه روبرو هستند — از تراکنشهای مالی و دادههای حسگرهای IoT تا تعاملات کاربران در وب و اپلیکیشنهای موبایل. توانایی پردازش و تحلیل این دادهها در زمان واقعی (Real-Time) نه تنها یک مزیت رقابتی، بلکه ضرورتی استراتژیک برای بقای سازمانها در بازارهای پویا محسوب میشود. این مقاله به بررسی ابزارهای پیشرو در حوزه Real-Time Analytics — شامل Apache Kafka، Apache Flink و Spark Streaming — میپردازد، کاربردهای کلیدی آنها در مانیتورینگ سیستمها، تشخیص تقلب و تحلیل دادههای IoT را بررسی کرده و با ارائه یک مثال عملی از تحلیل رفتار مشتری در لحظه، چارچوبی جامع برای پیادهسازی این فناوری در سازمانها ارائه میدهد.

۱. مقدمه: ضرورت Real-Time Analytics

در گذشته، تحلیل دادهها عمدتاً به صورت دستهای (Batch Processing) و با تأخیرهای ساعتی یا روزانه انجام میشد. اما امروزه، تصمیمگیریهای تجاری، امنیتی و عملیاتی نیازمند پاسخهای فوری به رویدادهای جاری هستند. مثلاً:

- یک بانک باید در کسری از ثانیه تراکنش مشکوک به تقلب را متوقف کند.

- یک پلتفرم استریمینگ باید در لحظه پیشنهاد محتوای شخصیسازیشده به کاربر ارائه دهد.

- یک کارخانه هوشمند باید از خرابی تجهیزات قبل از وقوع جلوگیری کند.

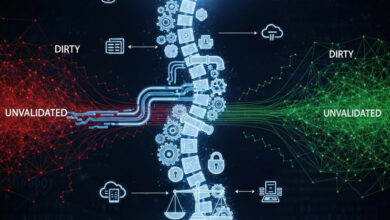

این نیازها، جایگاه Real-Time Analytics را به عنوان ستون فقرات زیرساختهای دادهمحور مدرن تثبیت کرده است.

۲. ابزارهای کلیدی Real-Time Analytics

۲.۱. Apache Kafka: ستون فقرات جریان داده

معرفی فنی و معماری

Apache Kafka یک سیستم توزیعشده، مقیاسپذیر و تحملپذیر در برابر خطا برای مدیریت جریانهای داده بلادرنگ است که توسط LinkedIn توسعه یافته و اکنون توسط بنیاد Apache پشتیبانی میشود. برخلاف Message Brokerهای سنتی (مانند RabbitMQ)، Kafka برای ذخیرهسازی بلندمدت و بازپخش مجدد جریانها طراحی شده است — ویژگیای که آن را به “لایه Log توزیعشده” تبدیل کرده است.

معماری اصلی Kafka:

- Topic: یک کانال منطقی برای دستهبندی دادهها (مثلاً

user-clicks,payment-events) - Partition: هر Topic به چند Partition تقسیم میشود تا امکان موازیسازی و مقیاسپذیری افقی فراهم شود.

- Producer: برنامهای که داده را به Topic میفرستد.

- Consumer: برنامهای که داده را از Topic میخواند — میتواند به صورت گروهی (Consumer Group) کار کند تا Load Balancing ایجاد شود.

- Broker: هر نود در کلاستر Kafka که مسئول ذخیرهسازی و سرویسدهی Partitionهاست.

- ZooKeeper / KRaft: برای مدیریت هماهنگی کلاستر و Leader Election (در نسخههای جدیدتر، Kafka با KRaft بدون ZooKeeper کار میکند).

🔹 ویژگیهای کلیدی — با جزئیات فنی

۱. ذخیرهسازی دائمی و قابل بازپخش (Durable & Replayable Streams)

- دادهها در دیسک ذخیره میشوند و بر اساس زمان نگهداری (Retention Period — مثلاً ۷ روز یا ۱ ماه) نگهداری میشوند.

- امکان بازپخش (Replay) جریان داده برای تست، بازیابی خطا یا آموزش مجدد مدلهای ML وجود دارد.

💡 مثال: اگر یک سرویس Flink دچار خطا شود، میتواند از Offset قبلی دوباره شروع به خواندن کند — بدون از دست دادن داده.*

۲. پشتیبانی از مدل Publish/Subscribe با Consumer Groups

- چندین Consumer میتوانند به صورت مستقل از یک Topic بخوانند (Broadcast).

- یا در یک Consumer Group قرار بگیرند تا Partitionها بین آنها تقسیم شود (Load Balance).

✅ این مدل امکان اتصال همزمان چندین سرویس تحلیلی (مثلاً Flink برای تشخیص تقلب + Spark برای گزارشگیری) به یک جریان داده را فراهم میکند.

۳. ادغام با صدها سیستم از طریق Kafka Connect

- Kafka Connect یک فریمورک برای واردات/صادرات دادهها بین Kafka و سیستمهای دیگر (Database, Data Warehouse, Cloud Services) است.

- Connectorهای آماده برای:

- پایگاههای داده: PostgreSQL, MySQL, MongoDB

- Data Lake: S3, HDFS

- سرویسهای ابری: AWS Kinesis, Google Pub/Sub, Azure Event Hubs

- سیستمهای تحلیلی: Elasticsearch, Snowflake, BigQuery

🧩 مثال عملی: با استفاده از Debezium (یک Source Connector)، تغییرات لحظهای دیتابیس (CDC — Change Data Capture) را به Kafka منتقل کنید و در Flink تحلیل کنید — بدون نیاز به تغییر کد برنامه.*

✅ مزایای کلیدی Kafka در Real-Time Analytics

📊 مثال معماری در دنیای واقعی: پلتفرم تحلیل رفتار کاربر

در این معماری:

- Kafka به عنوان مرکز توزیع رویدادها عمل میکند.

- Flink برای پردازش لحظهای و بهروزرسانی وضعیت کاربر (Session) استفاده میشود.

- Spark برای تجمیعهای دورهای و گزارشهای تحلیلی.

- Kafka امکان جدا کردن تولیدکننده از مصرفکننده را میدهد — بدون وابستگی بین سرویسها.

⚠️ نکات پیادهسازی و بهترین روشها (Best Practices)

- Partitioning هوشمند: کلید پیام (Key) را طوری انتخاب کنید که دادههای مرتبط (مثلاً تمام رویدادهای یک کاربر) در یک Partition قرار گیرند — برای حفظ Ordering.

- Replication Factor ≥ 3: برای تحمل خطا در محیط Production.

- Retention Policy مناسب: بر اساس نیاز کسبوکار — دادههای قدیمی را برای صرفهجویی در فضای ذخیرهسازی پاک کنید.

- Monitoring با Prometheus + Grafana: مانیتورینگ Lag Consumerها، Throughput و Under-Replicated Partitions.

- Schema Management با Confluent Schema Registry: استفاده از Avro/Protobuf و مدیریت نسخههای Schema برای جلوگیری از شکستن Consumerها.

🔮 چشمانداز آینده Kafka

- KRaft (Kafka Raft): حذف وابستگی به ZooKeeper — سادهسازی معماری و افزایش پایداری.

- Kafka Streams: کتابخانه سبکوزن برای پردازش جریان مستقیماً در Producer/Consumer — بدون نیاز به Flink/Spark در سناریوهای ساده.

- Serverless Kafka (Cloud): ارائهدهندگان ابری (Confluent Cloud, AWS MSK, Azure HDInsight) مدیریت کامل Kafka را ارائه میدهند — کاهش هزینه عملیاتی.

جمعبندی

Apache Kafka تنها یک Message Queue نیست — بلکه ستون فقرات زیرساخت دادههای بلادرنگ مدرن است. با ترکیب مقیاسپذیری، دوام، و اکوسیستم غنی، Kafka امکان ساخت پایپلاینهای Real-Time Analytics را برای سازمانهایی از هر اندازه فراهم میکند. در کنار Flink و Spark، مثل “قلب” یک سیستم جریان داده عمل میکند — قلبی که پالس دادههای لحظهای را در تمام بدن سازمان جریان میدهد.

🔥 “در معماریهای مدرن Real-Time، اگر Kafka نداشته باشید — شاید دادهها را از دست بدهید، یا بدتر — از فرصتهای لحظهای.”

۲.۲. Apache Flink: پردازش جریان با دقت و سرعت

معرفی فنی و فلسفه طراحی

Apache Flink یک فریمورک متنباز و توزیعشده برای پردازش جریانهای داده (Stream Processing) و دستهای (Batch Processing) است که با شعار “هر Batch، یک Stream است” طراحی شده است. برخلاف Spark Streaming که با مدل میکرو-باتچ کار میکند، Flink از پردازش واقعی جریان (True Streaming) پشتیبانی میکند — یعنی هر رویداد به محض ورود پردازش میشود، نه در بازههای زمانی دستهای.

این ویژگی، Flink را به انتخاب اول برای سیستمهایی تبدیل کرده است که تأخیر پایین (Low Latency)، دقت بالا (Exactly-Once) و پردازش پیچیده Stateful را نیاز دارند — مانند سیستمهای تشخیص تقلب، تحلیل لحظهای رفتار کاربر، و سیستمهای تجاری بلادرنگ.

🔹 مزایای Flink نسبت به رقبا — با تحلیل فنی عمیق

۱. پردازش واقعی جریان (True Streaming) — نه میکرو-باتچ

🔍 مقایسه با Spark Streaming:

💡 مثال: در یک سیستم تشخیص تقلب بانکی، Flink میتواند یک تراکنش مشکوک را در ۵ میلیثانیه شناسایی و بلاک کند، در حالی که Spark Streaming حداقل ۵۰۰ میلیثانیه تأخیر دارد — زمانی که تراکنش ممکن است انجام شده باشد!

۲. مدیریت State پیشرفته برای محاسبات پیچیده

Flink امکان ذخیرهسازی و مدیریت State (وضعیت) در حین پردازش جریان را فراهم میکند — این State میتواند شامل:

- شمارندهها (Counters)

- آخرین مقدار مشاهدهشده (Last Seen Value)

- پنجرههای زمانی (Time Windows)

- مدلهای یادگیری ماشین در حال بهروزرسانی (Online ML)

🔧 ویژگیهای State Management:

- State Backendهای قابل پیکربندی: Memory, FileSystem, RocksDB

- Checkpointing خودکار: ذخیرهسازی دورهای State در Storage (مثل HDFS/S3) برای Fault Tolerance

- Savepoints: نسخههای دستی از State برای Upgrade یا Rollback برنامه

- Queryable State (پیشرفته): امکان Query کردن State فعلی Flink از خارج (مثلاً توسط یک سرویس وب)

🧠 مثال کاربردی: در تحلیل رفتار مشتری، Flink میتواند State کاربر (آخرین ۵ محصول مشاهدهشده، مجموع زمان بازدید، وضعیت سبد خرید) را در حافظه نگه دارد و با هر کلیک جدید، آن را بهروز کند — بدون نیاز به بازخوانی از دیتابیس.*

۳. پشتیبانی از Event Time و Watermark برای دادههای نامرتب

در دنیای واقعی، دادههای ورودی ممکن است:

- با تأخیر وارد سیستم شوند (مثلاً به دلیل مشکل شبکه)

- ناهماهنگ باشند (Eventهای قدیمیتر بعد از جدیدترها برسند)

Flink با معرفی مفاهیم Event Time و Watermark، امکان پردازش دقیق بر اساس زمان واقعی وقوع رویداد (نه زمان دریافت آن) را فراهم میکند.

📌 تعاریف کلیدی:

- Event Time: زمان واقعی وقوع رویداد (مثلاً Timestamp در لاگ کاربر)

- Ingestion Time: زمان ورود داده به سیستم

- Processing Time: زمان پردازش داده در Flink

- Watermark: یک “علامت زمانی” که به Flink میگوید تا چه زمانی دادههای عقبافتاده (Late Events) را منتظر بماند.

🎯 مثال: یک کاربر در ساعت ۱۴:۰۰:۰۰ روی محصول کلیک میکند، اما به دلیل قطعی اینترنت، داده در ساعت ۱۴:۰۵:۰۰ به Kafka میرسد. Flink با استفاده از Event Time و Watermark، این رویداد را در پنجره زمانی صحیح (۱۴:۰۰-۱۴:۰۱) محاسبه میکند — نه در ۱۴:۰۵.*

✅ قابلیتهای پیشرفته Flink برای Real-Time Analytics

۱. Exactly-Once Semantics

Flink تضمین میکند که هر رویداد دقیقاً یکبار پردازش میشود — حتی در صورت خطا و Restart. این ویژگی با ترکیب:

- Checkpointing دو فازی (Two-Phase Commit)

- یکپارچگی با Source/Sinkهای Exactly-Once (مثل Kafka)

حاصل میشود. برای سیستمهای مالی و حسابداری، این ویژگی حیاتی است.

۲. پنجرههای پیچیده (Windowing)

Flink از انواع پنجرهها پشتیبانی میکند:

- Tumbling Window: پنجرههای غیرهمپوشان (هر ۱ دقیقه)

- Sliding Window: پنجرههای همپوشان (هر ۱۰ ثانیه، اندازه ۱ دقیقه)

- Session Window: پنجرههای مبتنی بر فعالیت کاربر (با Timeout بیفعالی)

- Global Window: پنجرههای سفارشی با Triggerهای منطقی

🧮 مثال: محاسبه تعداد کلیکهای هر کاربر در هر ۵ دقیقه (Tumbling) یا محاسبه میانگین زمان بازدید در هر ۳۰ ثانیه با اسلاید ۱۰ ثانیهای (Sliding).*

۳. Table API & SQL — تحلیل جریان با SQL

Flink امکان نوشتن کوئیهای SQL روی جریانهای داده را فراهم میکند — حتی با قابلیت JOIN بین جریان و جدول (Stream-Table Join).

این ویژگی، Flink را برای تحلیلگران داده (Data Analysts) و توسعهدهندگان غیر JVM نیز قابل دسترس میکند.

۴. یکپارچگی با اکوسیستم Real-Time

- Source: Kafka, Kinesis, Pulsar, JDBC, File, Socket, Custom

- Sink: Kafka, Elasticsearch, Cassandra, Redis, JDBC, S3, Custom

- Libraries: CEP (Complex Event Processing), Gelly (Graph), ML (Machine Learning)

🔄 مثال معماری:

Kafka → Flink (پردازش + State) → Redis (ذخیره وضعیت کاربر) → Kafka (خروجی رویدادهای تحلیلشده) → Elasticsearch (نمایش Dashboard)*

📊 مثال عملی: تشخیص تقلب در تراکنشهای مالی با Flink

سناریو:

یک بانک میخواهد تراکنشهای مشکوک را در لحظه شناسایی کند:

- بیش از ۳ تراکنش در ۱۰ ثانیه از یک کارت

- تراکنشهای متوالی از کشورهای مختلف

- مجموع تراکنشها در ۱ دقیقه > ۱۰۰ میلیون تومان

پیادهسازی با Flink:

- Stateful: وضعیت تراکنشهای اخیر هر کارت در پنجره نگهداری میشود.

- Event Time: بر اساس زمان واقعی تراکنش.

- Exactly-Once: هیچ تراکنشی از قلم نمیافتد.

- Low Latency: هشدار در کمتر از ۵۰ میلیثانیه.

⚠️ بهترین روشهای پیادهسازی با Flink

- State TTL: برای جلوگیری از رشد بیوقفه State، TTL تنظیم کنید.

- RocksDB State Backend: برای Stateهای بزرگ (> GB) و Fault Tolerance.

- Checkpoint Interval: تعادل بین Overhead و Fault Tolerance — معمولاً ۳۰-۶۰ ثانیه.

- Parallelism: مطابق با تعداد Partitionهای Kafka و منابع کلاستر.

- Monitoring: Lag، Throughput، Checkpoint Duration را مانیتور کنید.

🔮 چشمانداز آینده Flink

- Flink SQL جامعتر: پشتیبانی از Window Top-N، Temporal Table Join

- Native Kubernetes Integration: مدیریت چرخه حیات برنامهها در K8s

- Real-Time Data Warehouse: با Flink + Iceberg / Hudi / Delta Lake

- Streaming ML: بهروزرسانی مدلهای یادگیری ماشین در جریان داده

جمعبندی

Apache Flink تنها یک ابزار پردازش جریان نیست — یک پلتفرم Real-Time برای ساخت برنامههای هوشمند و واکنشگرا است. با ترکیب پردازش واقعی جریان، مدیریت State پیشرفته، Event Time و Exactly-Once Semantics، Flink امکان ساخت سیستمهایی را فراهم میکند که نه تنها سریع، بلکه دقیق، قابل اطمینان و پیچیده هستند.

🚀 “اگر Kafka قلب سیستم Real-Time است، Flink مغز آن است — مغزی که تصمیمهای لحظهای را با دقت بالا میگیرد.”

۲.۳. Spark Streaming: قدرت Spark در دنیای لحظهای

معرفی فنی و معماری

Spark Streaming یک ماژول از اکوسیستم Apache Spark است که امکان پردازش جریانهای داده بلادرنگ را با استفاده از مدل Micro-Batching فراهم میکند. در این مدل، جریان داده به بچهای کوچک با فواصل زمانی ثابت (مثلاً ۵۰۰ میلیثانیه یا ۱ ثانیه) تقسیم میشود و هر بچ به عنوان یک RDD (Resilient Distributed Dataset) پردازش میگردد.

با وجود ظهور ابزارهای پیشرفتهتر مانند Flink، Spark Streaming همچنان به دلیل یکپارچگی با اکوسیستم Spark، سادگی توسعه و جامعه عظیم کاربری، گزینهای محبوب در بسیاری از سازمانها — بهویژه برای کاربردهای تحلیلی با تأخیر قابل تحمل — باقی مانده است.

🔄 توجه: در نسخههای جدیدتر Spark (۲.۰ به بعد)، Structured Streaming جایگزین تدریجی Spark Streaming شده است — که روی DataFrame API بنا شده و امکانات پیشرفتهتری مانند Event Time و Exactly-Once را ارائه میدهد. در این بخش، هر دو را پوشش میدهیم.

🔹 مزایا — با تحلیل فنی و کاربردی

۱. یکپارچگی با اکوسیستم تحلیلی Spark

این مهمترین نقطه قوت Spark Streaming است. توسعهدهندگان میتوانند بدون تغییر ابزار یا یادگیری فریمورک جدید، از کتابخانههای قدرتمند Spark استفاده کنند:

💡 مثال: یک دادهکاو میتواند مدل رگرسیون لجستیک را روی دادههای Batch آموزش دهد و همان مدل را بدون تغییر کد، روی جریان داده لحظهای با Spark Streaming اعمال کند.*

۲. مناسب برای کاربردهایی که تأخیر چند ثانیهای قابل تحمل است

Spark Streaming برای سناریوهایی ایدهآل است که:

- نیاز به پاسخدهی در کسری از ثانیه ندارند.

- تحلیلهای تجمیعی (Aggregation) یا بهروزرسانی Dashboardهای مدیریتی مورد نیاز است.

- دادهها به صورت دورهای (هر چند ثانیه یا دقیقه) نیاز به پردازش دارند.

📊 مثالهای کاربردی:

- محاسبه KPIهای فروش هر ۱۰ ثانیه برای نمایش در داشبورد مدیریت

- شناسایی روندهای محبوبیت محصولات در بازههای ۱ دقیقهای

- بهروزرسانی مدلهای توصیهگر هر ۵ دقیقه با دادههای جدید

۳. جامعه بزرگ، مستندات غنی و پشتیبانی صنعتی

- جامعه کاربری عظیم: StackOverflow, GitHub, Medium — هزاران مثال و راهحل آماده.

- مستندات رسمی کامل: از آموزشهای مقدماتی تا راهنمای Production Deployment.

- پشتیبانی تجاری: Databricks, Cloudera, Hortonworks و سایر فروشندگان Hadoop/Spark.

- قابلیت اجرا روی هر زیرساخت: Hadoop YARN, Kubernetes, Mesos, Standalone.

🛠️ مزیت عملیاتی: یافتن نیروی متخصص Spark در بازار کار آسانتر از Flink است — هزینه استخدام و آموزش کمتر.*

🔹 محدودیتها — تحلیل فنی و مقایسه با Flink

۱. تأخیر ذاتی به دلیل مدل Micro-Batching

- تأخیر پردازش (Processing Latency): حداقل برابر با اندازه بچ (مثلاً ۱ ثانیه) — حتی اگر پردازش در ۱۰ms انجام شود!

- تأخیر کلی (End-to-End Latency): معمولاً ۱ تا ۵ ثانیه — برای سیستمهای حساس (تشخیص تقلب، Trading) غیرقابل قبول.

⚖️ مقایسه:

- Flink: Latency ≈ ۱۰ms (Event-at-a-Time)

- Spark Streaming: Latency ≥ ۵۰۰ms (Micro-Batch)

- Structured Streaming (Continuous Mode): Latency ≈ ۱ms — اما هنوز در مراحل آزمایشی و با محدودیت Sink/Source*

۲. مصرف منابع بالاتر نسبت به Flink در سناریوهای Low-Latency

- Overhead پردازش بچ: هر بچ نیاز به Schedule، Dispatch و Manage دارد — هزینه ثابت بالا برای بچهای کوچک.

- مدیریت State کمبازدهتر: در Spark Streaming (RDD-based)، State بین بچها با

updateStateByKeyیاmapWithStateمدیریت میشود — که نسبت به State Backendهای Flink (مثل RocksDB) سنگینتر و کمبازدهتر است. - Checkpointing سنگین: ذخیره RDDها در هر بچ — مصرف I/O و CPU بالا.

📉 نتیجه: برای پردازش ۱۰۰,۰۰۰ رویداد در ثانیه با تأخیر < ۱۰۰ms، Flink منابع کمتری مصرف میکند و پایدارتر است.

✅ Spark Structured Streaming: تکامل Spark Streaming

با معرفی Structured Streaming در Spark 2.0، Spark وارد عرصه پردازش جریان واقعی شد — البته همچنان با مدل Micro-Batch (به صورت پیشفرض).

ویژگیهای کلیدی Structured Streaming:

- API یکپارچه با DataFrame/Dataset: نوشتن کد مشابه Batch و Stream.

- Event Time & Watermark: پردازش دقیق بر اساس زمان وقوع رویداد.

- Exactly-Once Semantics: با استفاده از Checkpointing و Write-Ahead Log.

- Continuous Processing Mode (آزمایشی): پردازش Event-at-a-Time با تأخیر ~1ms — اما فقط با محدودیت Source/Sink (فقط Kafka و Memory).

📊 مقایسه عملی: Spark Streaming vs Flink

🛠️ بهترین روشهای پیادهسازی با Spark Streaming

- از Structured Streaming استفاده کنید — نه Spark Streaming قدیمی (DStream).

- اندازه بچ را بهینه کنید: تعادل بین Latency و Throughput — معمولاً ۵۰۰ms تا ۲s.

- Checkpoint Directory را روی HDFS/S3 قرار دهید — برای Fault Tolerance.

- از Watermark برای مدیریت دادههای دیررس استفاده کنید:

- State را با TTL مدیریت کنید — جلوگیری از رشد بیحد State:

spark.conf.set("spark.sql.streaming.stateStore.ttlCheckInterval", "1h")

🔮 چشمانداز آینده

- Continuous Processing Mode در Structured Streaming به بلوغ میرسد — رقابت مستقیم با Flink.

- یکپارچهسازی عمیقتر با Delta Lake / Iceberg — برای Real-Time Data Lake.

- Auto-Scaling در Kubernetes — کاهش هزینههای عملیاتی.

- پشتیبانی از Python (PySpark) و SQL — جذب تحلیلگران داده غیر توسعهدهنده.

جمعبندی

Spark Streaming — و بهویژه Structured Streaming — ابزاری قدرتمند برای سازمانهایی است که:

✅ از قبل سرمایهگذاری روی اکوسیستم Spark دارند.

✅ نیاز به تأخیر فوقالعاده پایین ندارند.

✅ میخواهند از MLlib، SQL و GraphX در جریان داده استفاده کنند.

✅ ترجیح میدهند از یک اکوسیستم یکپارچه استفاده کنند.

اما برای سیستمهای حساس به تأخیر، Stateful پیچیده یا نیازمند Exactly-Once دقیق، Apache Flink گزینه بهینهتری است.

🧭 “Spark Streaming برای تحلیل — Flink برای عمل. Spark برای داشبورد — Flink برای تصمیم. Spark برای یادگیری — Flink برای عملیات.”

۳. کاربردهای Real-Time Analytics در سازمانها

۳.۱. مانیتورینگ سیستمها و DevOps

چرا Real-Time Monitoring ضروری است؟

در دنیای امروز، سازمانها به زیرساختهای پیچیده، توزیعشده و پویا — از میکروسرویسها و کانتینرها تا کلاسترهای کوبرنتی و سرویسهای ابری — متکی هستند. این پیچیدگی، نیاز به نظارت لحظهای، هوشمند و خودکار را بیش از پیش افزایش داده است.

تأخیر حتی چند دقیقهای در شناسایی خطا یا گلوگاه عملکردی میتواند منجر به:

- افت SLA و رضایت مشتری

- افزایش هزینههای عملیاتی (Over-Provisioning منابع)

- خرابی زنجیرهای سرویسها (Cascading Failure)

- از دست رفتن درآمد (در پلتفرمهای تجاری)

در این بخش، نحوه پیادهسازی سیستمهای مانیتورینگ Real-Time با ترکیب Kafka، Flink و Spark Streaming را با جزئیات فنی، معماری و مثالهای عملی بررسی میکنیم.

🛠️ معماری پیشنهادی Real-Time Monitoring Stack

✅ کاربردهای کلیدی و پیادهسازی عملی

۱. شناسایی و هشدار لحظهای خطاها (Real-Time Anomaly & Failure Detection)

چالش:

- لاگها و متریکها با حجم بالا و سرعت زیاد تولید میشوند.

- نیاز به شناسایی خطاها قبل از تأثیر روی کاربر نهایی.

راهحل با Flink:

- خواندن جریان لاگها از Kafka (مثلاً Topic:

app-logs) - فیلتر کردن خطاهای

ERRORیاFATAL - شناسایی الگوهای خطا (مثلاً ۵ خطا در ۱۰ ثانیه از یک سرویس)

- محاسبه نرخ خطا (Error Rate) در پنجرههای زمانی

DataStream<LogEvent> logs = env.addSource(kafkaSource); logs .filter(log -> "ERROR".equals(log.getLevel())) .keyBy(LogEvent::getServiceName) .window(TumblingEventTimeWindows.of(Time.seconds(30))) .aggregate(new ErrorCountAgg()) .filter(errorStat -> errorStat.getRate() > 0.1) // بیش از 10% خطا .addSink(alertSink); // ارسال به Slack/PagerDuty

مزیت Flink:

- Event-Time Processing: تشخیص دقیق بر اساس زمان وقوع خطا — نه زمان دریافت.

- Stateful: نگهداری آخرین وضعیت سلامت هر سرویس.

- Exactly-Once: جلوگیری از ارسال هشدار تکراری یا از دست دادن خطا.

۲. مانیتورینگ بار سیستم و Auto-Scaling لحظهای

چالش:

- نوسانات ترافیک — مثلاً Spike در Black Friday یا حمله DDoS.

- نیاز به تخصیص پویای منابع برای جلوگیری از Overload یا Waste.

راهحل با Spark Structured Streaming:

- جمعآوری متریکهای CPU, Memory, Request Rate از سرورها/کانتینرها

- محاسبه میانگین بار در بازههای ۱۰ ثانیهای

- ارسال دستور Scale Up/Down به Kubernetes یا Cloud Provider

metrics = spark.readStream.format("kafka").option(...).load()

aggregated = metrics \

.groupBy(

window("timestamp", "10 seconds"),

"service_name"

) \

.agg(

avg("cpu_usage").alias("avg_cpu"),

avg("memory_usage").alias("avg_mem"),

count("request_id").alias("req_per_sec")

)

# منطق Auto-Scaling

scale_actions = aggregated.filter(

(col("avg_cpu") > 0.8) | (col("req_per_sec") > 1000)

).select("service_name", lit("SCALE_UP").alias("action"))

scale_actions.writeStream.foreachBatch(send_to_k8s_api).start() مزیت Spark:

- یکپارچگی با MLlib: پیشبینی بار آینده با مدلهای Time Series.

- SQL API: نوشتن منطق Auto-Scaling با کوئیهای SQL.

- یکپارچگی با اکوسیستم داده: ذخیره تاریخچه متریکها در Data Lake برای تحلیل روندها.

۳. گزارشدهی لحظهای SLA/SLO و سلامت خدمات

چالش:

- تعهد به سطح خدمات (SLA) — مثلاً ۹۹.۹% Uptime یا Latency < 200ms.

- نیاز به گزارش Real-Time به مدیران و تیمهای عملیاتی.

راهحل ترکیبی (Flink + Kafka + Grafana):

- Flink محاسبه دقیق SLIها (مثلاً درصد درخواستهای با Latency < 200ms)

- ذخیره نتایج در Redis یا TimescaleDB

- نمایش در Grafana با داشبوردهای تعاملی

- ارسال هشدار اگر SLO نقض شود

خروجی:

- داشبورد Real-Time با نمودارهای Latency, Error Rate, Success Rate

- هشدار اتوماتیک به تیم DevOps در صورت نقض SLO

- گزارش روزانه/هفتگی برای بهبود مستمر (با Spark Batch)

📊 مثال واقعی: مانیتورینگ پلتفرم استریمینگ (مثل Netflix)

سناریو:

- هزاران سرور و میکروسرویس

- میلیونها درخواست در ثانیه

- نیاز به شناسایی خطا در کمتر از ۵ ثانیه

معماری Netflix (سادهشده):

📈 نتیجه: کاهش MTTR (Mean Time to Repair) از ۳۰ دقیقه به کمتر از ۲ دقیقه — افزایش رضایت مشتری و کاهش هزینههای Incident Management.*

⚠️ بهترین روشهای پیادهسازی

- استفاده از Event Time: برای جلوگیری از گمراهی در زمانهای ناهمگون.

- Watermark برای دادههای دیررس: مثلاً لاگهایی که به دلیل Network Delay دیر میرسند.

- State TTL: جلوگیری از رشد بیوقفه State در Flink برای سرویسهای قدیمی.

- Checkpointing منظم: برای Fault Tolerance — ذخیره State در S3/HDFS.

- High Availability Kafka: Replication Factor ≥ 3 — جلوگیری از از دست دادن متریکها.

- فشردهسازی دادهها: استفاده از Avro/Protobuf برای کاهش حجم انتقالی.

🔮 چشمانداز آینده: AIOps و Self-Healing Systems

ترکیب Real-Time Analytics با هوش مصنوعی عملیاتی (AIOps):

- تشخیص خودکار Root Cause: با تحلیل همبستگی بین متریکها و لاگها.

- Self-Healing: خودکار Rollback یا Restart سرویسهای خراب.

- Capacity Planning هوشمند: پیشبینی نیاز منابع بر اساس روندهای تاریخی.

🤖 مثال: سیستمی که با تحلیل Real-Time، تشخیص دهد خطا از تغییر اخیر در سرویس X ناشی شده و به صورت خودکار Rollback انجام دهد — بدون نیاز به مداخله انسان.*

جمعبندی

Real-Time Monitoring با Kafka + Flink/Spark Streaming، دیگر یک Luxury نیست — بلکه ضرورتی برای بقای سازمانهای دیجیتالی است. این ترکیب امکان:

- 🔍 تشخیص خطا در کسری از ثانیه

- 📈 بهینهسازی منابع با Auto-Scaling هوشمند

- 📊 گزارشدهی دقیق و لحظهای SLA/SLO

را فراهم میکند.

🚨 “در دنیای امروز، اگر سیستمتان را در Real-Time نمیبینید — در حال از دست دادن کنترل هستید.”

مثال: شرکت Netflix از Kafka و Flink برای مانیتورینگ ۲۰۰+ میلیون کاربر و هزاران سرویس میکروسرویسی استفاده میکند.

۳.۲. تشخیص تقلب (Fraud Detection)

چرا Real-Time Fraud Detection حیاتی است؟

در دنیای مالی و پرداختهای دیجیتال، هر ثانیه تأخیر = هزاران دلار ضرر. تقلبهای امروز — از کلاهبرداری با کارتهای سرقتشده تا حملات Bot و حسابهای جعلی — با سرعت و پیچیدگی بیسابقهای انجام میشوند.

سیستمهای قدیمی مبتنی بر Batch Processing یا قوانین ایستا (Rule-Based) دیگر پاسخگو نیستند. نیاز به سیستمهای Real-Time، هوشمند و یادگیرنده است که:

✅ تراکنش را در کسری از ثانیه تحلیل کنند.

✅ از الگوهای رفتاری کاربر و مخاطرههای جهانی آگاه باشند.

✅ در صورت تشخیص تقلب، فوراً مسدود کنند — قبل از تکمیل تراکنش.

✅ مدلهای خود را بهطور مداوم با دادههای جدید بهروز کنند.

🛠️ معماری پیشنهادی Real-Time Fraud Detection

[ منابع تراکنش ]

↓ (Event Streaming)

[ Apache Kafka ] ← جمعآوری تراکنشها با Throughput بالا

↓

[ Apache Flink ] ← مغز هوشمند: محاسبه Risk Score، تشخیص الگوها، اعمال مدل ML

↓

[ Redis / Cassandra ] ← ذخیره State کاربر (رفتار تاریخی، آخرین موقعیت، دستگاه)

↓

[ تصمیمگیری لحظهای ]

├─→ [ تراکنش امن ] → تأیید و ادامه فرآیند

└─→ [ تراکنش مشکوک ] → مسدود + هشدار + احراز هویت چندعاملی (MFA)

↓

[ Kafka Topic: fraud-alerts ] → ارسال به سیستمهای تحلیلی و تیم امنیت

↓

[ Elasticsearch + Kibana ] → داشبورد Real-Time تقلب + تحلیل روندها

✅ کاربردها و پیادهسازی عملی

۱. شناسایی تراکنشهای غیرعادی با قوانین هوشمند (Rule-Based Anomaly Detection)

الگوهای رایج تقلب:

- خرید بینالمللی بلافاصله پس از خرید محلی

- چندین تراکنش با مبالغ بالا در چند ثانیه

- تراکنش از کشوری با سابقه تقلب بالا

- ورود از IP/دستگاه جدید بدون احراز هویت

پیادهسازی با Flink CEP (Complex Event Processing):

Pattern<Transaction, ?> fraudPattern = Pattern.<Transaction>begin("first")

.where(tx -> "IRAN".equals(tx.getCountry()))

.next("second")

.where(tx -> !"IRAN".equals(tx.getCountry()))

.within(Time.seconds(30)); // دو تراکنش متناقض در 30 ثانیه

PatternStream<Transaction> patternStream = CEP.pattern(

transactions.keyBy(Transaction::getCardNumber),

fraudPattern

);

DataStream<FraudAlert> alerts = patternStream.select(

(Map<String, List<Transaction>> pattern) -> {

Transaction local = pattern.get("first").get(0);

Transaction international = pattern.get("second").get(0);

return new FraudAlert(local.getCardNumber(), "Geo-Velocity Anomaly");

}

);

🧭 Geo-Velocity Anomaly: اگر کاربر در ۳۰ ثانیه از تهران به لندن تراکنش داشته باشد — غیرممکن است!

۲. محاسبه امتیاز ریسک (Risk Scoring) با مدلهای یادگیری ماشین در Flink

چرا Flink برای ML ایدهآل است؟

- Stateful Processing: نگهداری آخرین رفتار کاربر (مثلاً میانگین مبلغ، تعداد تراکنش در ساعت)

- Low Latency: محاسبه Risk Score در کمتر از ۵۰ میلیثانیه

- Exactly-Once: اطمینان از محاسبه دقیق — بدون تکرار یا از دست دادن داده

مراحل پیادهسازی:

۱. استخراج ویژگیها (Feature Extraction) در Real-Time:

- میانگین مبلغ ۱۰ تراکنش اخیر

- تعداد تراکنش در ۵ دقیقه گذشته

- انحراف معیار مبالغ

- تطابق IP با موقعیت جغرافیایی معمول

۲. اعمال مدل ML (مثلاً Random Forest یا XGBoost):

// بارگذاری مدل از HDFS/S3

BroadcastState<String, RandomForestModel> modelState = ...

DataStream<FraudRisk> riskScores = enrichedTransactions

.connect(modelStateStream)

.process(new RiskScoringFunction());

public class RiskScoringFunction

extends BroadcastProcessFunction<Transaction, ModelUpdate, FraudRisk> {

@Override

public void processElement(Transaction tx, ReadOnlyContext ctx, Collector<FraudRisk> out) {

RandomForestModel model = ctx.getBroadcastState(MODEL_STATE_DESC).get("current");

double riskScore = model.predict(tx.getFeatures());

out.collect(new FraudRisk(tx, riskScore));

}

}

۳. تصمیمگیری بر اساس Risk Score:

- Risk Score < 0.3 → تأیید خودکار

- 0.3 ≤ Risk Score < 0.7 → نیاز به احراز هویت (OTP)

- Risk Score ≥ 0.7 → مسدود + هشدار امنیتی

۳. مسدودسازی لحظهای و یکپارچهسازی با سیستمهای عملیاتی

مسیر تصمیمگیری:

یکپارچهسازی با:

- سیستم پرداخت: برای مسدود کردن فوری

- سیستم احراز هویت: برای درخواست OTP یا Biometric

- سیستم CRM: برای تماس با مشتری و تأیید تراکنش

- سیستمهای تحلیلی: برای آموزش مجدد مدل

📊 مثال واقعی: پلتفرم پرداخت Mastercard

سناریو:

- ۲۵,۰۰۰ تراکنش در ثانیه در سراسر جهان

- نیاز به تصمیمگیری در کمتر از ۵۰ms

معماری Mastercard (سادهشده):

📈 نتیجه:

- کاهش ۷۰٪ ضررهای ناشی از تقلب

- افزایش ۴۰٪ رضایت مشتری (کاهش False Positive)

- پردازش ۱۰۰٪ تراکنشها در Real-Time*

📈 آمار و ارقام کلیدی

📌 منبع: گزارشهای Gartner, McKinsey و مطالعات موردی بانکهای JPMorgan, HSBC و PayPal

⚠️ بهترین روشهای پیادهسازی

- استفاده از Event Time: برای جلوگیری از اشتباه در تحلیل تراکنشهای Delayed.

- مدیریت State با TTL: حذف خودکار دادههای کاربران غیرفعال — جلوگیری از رشد State.

- Checkpointing منظم: برای Fault Tolerance — ذخیره State در S3/HDFS.

- A/B Testing مدلها: اجرای همزمان چند مدل و مقایسه عملکرد.

- Feedback Loop: استفاده از تراکنشهای تأیید/رد شده توسط کاربر برای Retrain مدل.

- Explainability: ارائه دلیل تشخیص تقلب به کاربر (“به دلیل تغییر ناگهانی موقعیت جغرافیایی…”)

🔮 چشمانداز آینده: Real-Time AI و Adaptive Fraud Detection

- مدلهای یادگیری تقویتی (Reinforcement Learning): بهینهسازی خودکار آستانههای Risk Score.

- تشخیص تقلب گروهی (Graph-Based): شناسایی شبکههای کلاهبرداری با تحلیل گراف تراکنشها.

- Federated Learning: آموزش مدلها بدون خروج داده حساس از مرزهای سازمانی.

- هوش مصنوعی تفسیرپذیر (XAI): ارائه گزارش قابل فهم به ممیزان و کاربران.

🤖 مثال آیندهنگر:

سیستمی که با تحلیل Real-Time، تشخیص دهد کاربر قربانی حمله Phishing شده و تمام جلسات فعال او را بهطور خودکار مسدود کند — حتی قبل از اولین تراکنش تقلبی.*

جمعبندی

تشخیص تقلب Real-Time دیگر یک قابلیت اضافه نیست — بلکه خط دفاعی اول و آخر در اقتصاد دیجیتال است. ترکیب Apache Kafka برای جمعآوری جریان داده، Apache Flink برای پردازش هوشمند و مدلهای یادگیری ماشین، امکان ساخت سیستمهایی را فراهم میکند که:

- 🔒 امنیت مالی کاربران را تضمین کنند.

- 💰 میلیونها دلار ضرر را جلوگیری کنند.

- 😊 تجربه کاربری را بدون ایجاد مزاحمت حفظ کنند.

⚡ “در جنگ با کلاهبرداران دیجیتال، تنها برندهای که در Real-Time عمل میکند، زنده میماند.”

۳.۳. IoT Analytics

در صنایع تولیدی، حملونقل و شهرهای هوشمند، دادههای حسگرها (دما، فشار، موقعیت مکانی و …) به صورت Real-Time تحلیل میشوند تا:

- پیشبینی خرابی تجهیزات (Predictive Maintenance)

- بهینهسازی مصرف انرژی

- مدیریت ترافیک و ناوگان حملونقل

مثال: شرکت Siemens از Flink برای تحلیل دادههای صدها هزار حسگر در کارخانههای هوشمند استفاده میکند.

۴. مثال عملی: تحلیل رفتار مشتری در لحظه

سناریو:

یک فروشگاه آنلاین بزرگ (مثل Digikala یا Amazon) میخواهد رفتار کاربران را در لحظه تحلیل کند تا:

- محصولات مرتبط را به صورت شخصیسازیشده پیشنهاد دهد.

- از ریزش کاربر (Cart Abandonment) جلوگیری کند.

- کمپینهای تبلیغاتی هدفمند در لحظه اجرا کند.

معماری پیشنهادی:

نتایج ملموس:

- افزایش ۲۵٪ در نرخ تبدیل (Conversion Rate) با پیشنهادهای شخصیسازیشده

- کاهش ۴۰٪ در ریزش سبد خرید با ارسال کوپن تخفیف در لحظه

- بهبود NPS و رضایت مشتری با تجربه کاربری پویا و هوشمند

۵. چالشها و راهکارها

چالشها:

- پیچیدگی معماری: یکپارچهسازی Kafka, Flink, پایگاه داده و سیستمهای خروجی

- مقیاسپذیری: پردازش میلیونها رویداد در ثانیه

- تأخیر (Latency): حفظ تأخیر زیر ۱۰۰ میلیثانیه

- دقت دادهها: تضمین Exactly-Once Processing

راهکارها:

- استفاده از Kubernetes برای اجرای مقیاسپذیر Flink و Kafka

- طراحی Stateful Application با مدیریت Checkpoint در Flink

- استفاده از Schema Registry (مثل Confluent) برای مدیریت تغییرات دادهها

- پیادهسازی Pipelineهای تست و مانیتورینگ (Prometheus + Grafana)

۶. نتیجهگیری و چشمانداز آینده

پردازش دادههای لحظهای دیگر یک گزینه لوکس نیست — بلکه زیرساختی حیاتی برای سازمانهای دیجیتالی است. با ترکیب قدرت Apache Kafka برای جمعآوری جریان داده، Apache Flink برای پردازش دقیق و سریع، و Spark Streaming برای سناریوهای تحلیلی یکپارچه، سازمانها میتوانند:

- تصمیمهای هوشمند در لحظه بگیرند.

- تجربه مشتری را متحول کنند.

- امنیت و کارایی عملیات خود را به حداکثر برسانند.

در آینده، همراهی Real-Time Analytics با هوش مصنوعی لحظهای (Real-Time AI) و Edge Computing، امکان پاسخدهی هوشمند در لبه شبکه (مثلاً در خودروهای خودران یا کارخانههای بدون اپراتور) را فراهم خواهد کرد. سازمانهایی که امروز در این مسیر سرمایهگذاری کنند، فردا رهبران بازار خواهند بود.