بهترین ابزارهای علوم داده در سال ۲۰۲۵

راهنمای جامع برای زبانها، کتابخانهها، پلتفرمها و ترندهای آینده

مقدمه: چرا شناخت ابزارهای علوم داده در ۲۰۲۵ اهمیت دارد؟

علوم داده (Data Science) یکی از سریعترین حوزههای در حال رشد در جهان فناوری است. سازمانها و شرکتها در حال سرمایهگذاری عظیم روی دادهها هستند تا از طریق تحلیل، پیشبینی و مدلسازی بتوانند تصمیمگیریهای هوشمندانهتر داشته باشند. در سال ۲۰۲۵، نقش دادهها حتی بیش از گذشته حیاتی خواهد بود؛ چرا که هم حجم دادهها به شکل تصاعدی افزایش مییابد و هم مدلهای هوش مصنوعی پیشرفتهتر نیازمند ابزارهای دقیقتر و یکپارچهتر هستند.

اما سؤال اصلی این است:

یک متخصص داده در سال ۲۰۲۵ باید چه ابزارهایی را بداند؟

آیا هنوز هم پایتون حرف اول را میزند؟ آیا ابزارهای ویژوالیزاسیون سنتی مثل Tableau جای خود را به اپلیکیشنهای سبکتر مثل Streamlit میدهند؟ و مهمتر از همه، چگونه باید خود را برای آیندهای آماده کنیم که در آن اتوماسیون و یکپارچهسازی چرخه حیات داده حرف اول را میزند؟

در این مقاله جامع، به بررسی بهترین ابزارهای علوم داده در سال ۲۰۲۵ میپردازیم. این بررسی شامل:

- زبانهای برنامهنویسی

- محیطهای توسعه و پلتفرمها

- کتابخانههای کلیدی یادگیری ماشین و یادگیری عمیق

- ابزارهای ویژوالیزاسیون و داستانسرایی داده

- ابزارهای نوظهور و آیندهدار

- و در نهایت ترندهای کلیدی سال ۲۰۲۵

این مقاله بیش از یک لیست ساده است. ما سعی میکنیم هر ابزار را در زمینهی خودش تحلیل کنیم: چه کسانی باید از آن استفاده کنند، چه زمانی بهترین انتخاب است، و چه آیندهای برای آن متصور هستیم.

زبانهای برنامهنویسی در علوم داده 2025: پایتون، R و Julia — مقایسه جامع و استراتژی انتخاب بهینه

در دنیای پویای علوم داده، انتخاب زبان برنامهنویسی نه تنها یک تصمیم فنی، بلکه یک استراتژی کلیدی برای موفقیت پروژه است. هیچ پروژه دادهای — از یک تحلیل ساده گرفته تا یک سیستم هوش مصنوعی صنعتی — بدون یک زبان برنامهنویسی قدرتمند آغاز نمیشود.

در سال 2025، سه زبان پایتون (Python)، R و Julia به عنوان ستونهای اصلی اکوسیستم علوم داده شناخته میشوند. هر کدام از این زبانها نقاط قوت، محدودیتها و حوزههای تخصصی خود را دارند. انتخاب نادرست میتواند منجر به کاهش سرعت توسعه، مشکلات مقیاسپذیری، یا حتی شکست پروژه شود.

در این مقاله، یک تحلیل جامع، حرفهای و بهروز از این سه زبان ارائه میشود که برای دانشجویان، دیتا ساینتیستها، مهندسان داده و مدیران فناوری طراحی شده است.

🔹 چرا انتخاب زبان برنامهنویسی در علوم داته حیاتی است؟

انتخاب زبان فقط به “کد زدن” محدود نمیشود. این انتخاب بر موارد زیر تأثیر مستقیم دارد:

- سرعت توسعه (Development Speed)

- عملکرد و کارایی (Performance)

- مقیاسپذیری (Scalability)

- یکپارچهسازی با ابزارهای دیگر (ETL، BI، MLOps)

- جامعه کاربری و پشتیبانی

- امکان استخدام نیرو و آموزش

در ادامه، به بررسی دقیق سه زبان اصلی میپردازیم.

🔹 1.1. پایتون (Python) — سلطان بلامنازع علوم داده

🏆 وضعیت در سال 2025:

پایتون همچنان پادشاه بیرقیب دنیای علوم داده است. بر اساس گزارشهای Kaggle، Stack Overflow و IEEE، پایتون به عنوان پرکاربردترین زبان در حوزه داده شناخته میشود.

✅ دلایل موفقیت پایتون:

1. اکوسیستم غنی و یکپارچه

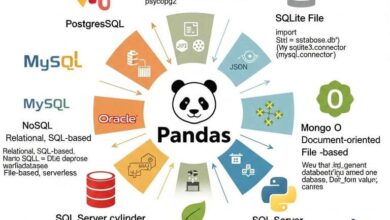

- Pandas: پردازش داده و تحلیل

- NumPy: محاسبات عددی و آرایهها

- Scikit-learn: یادگیری ماشین کلاسیک

- TensorFlow / PyTorch: یادگیری عمیق و مدلهای بزرگ

- Matplotlib / Seaborn / Plotly: تجسم داده

- FastAPI / Flask: سرویسدهی مدلها

- Airflow / Prefect: مدیریت فرآیندهای داده

2. جامعه کاربری بزرگ و فعال

- میلیونها توسعهدهنده در سراسر جهان

- مستندات گسترده، آموزشهای رایگان، و کتابهای تخصصی

- پشتیبانی قوی از شرکتهای بزرگ (Google, Meta, Microsoft)

3. سادگی و خوانایی بالا

- نحو (Syntax) ساده و شبیه به زبان انگلیسی

- یادگیری آسان برای کسانی که از رشتههای غیرفنی (اقتصاد، علوم اجتماعی، پزشکی) وارد حوزه داده میشوند

4. یکپارچهسازی با تمام حوزههای فناوری

- وباسکرپینگ (BeautifulSoup, Scrapy)

- پردازش زبان طبیعی (spaCy, NLTK)

- اتوماسیون اداری (openpyxl, PyPDF2)

- توسعه وب (Django, FastAPI)

🔮 روندهای آینده در 2025:

- بهینهسازی سرعت: استفاده از کتابخانههایی مانند Polars (جایگزین Pandas)، Numba (کامپایل کد پایتون به C)، و Cython

- هماهنگی با مدلهای بزرگ (LLMs): ابزارهایی مانند LangChain، LlamaIndex و Hugging Face عمدتاً بر پایه پایتون هستند

- توسعه MLOps: ابزارهایی مانند MLflow، Kubeflow و DVC از پایتون پشتیبانی میکنند

⚠️ معایب:

- سرعت اجرا پایین نسبت به زبانهای کامپایلی (مثل C یا Julia)

- مدیریت حافظه ضعیف در پروژههای حجیم

- Global Interpreter Lock (GIL): محدودیت در پردازش موازی واقعی

🎯 بهترین کاربردها:

- تحلیل داده و هوش تجاری (BI)

- یادگیری ماشین و یادگیری عمیق

- پردازش زبان طبیعی (NLP)

- اتوماسیون پردازش داده

- توسعه مدلهای LLM و RAG

🔹 1.2. زبان R — ابزار تخصصی برای تحلیل آماری و تحقیقات علمی

🏆 وضعیت در سال 2025:

اگرچه R در مقایسه با پایتون در پروژههای صنعتی کمتر دیده میشود، اما همچنان سلطان تحلیل آماری و تحقیقات دانشگاهی است.

✅ دلایل محبوبیت R:

1. پکیجهای آماری بینظیر

- tidyverse: مجموعهای از پکیجها برای پاکسازی، تبدیل و تحلیل داده (dplyr, tidyr, readr)

- ggplot2: یکی از قدرتمندترین ابزارهای ترسیم نمودار در دنیا

- caret و tidymodels: برای مدلسازی یادگیری ماشین

- forecast: برای تحلیل سریهای زمانی

2. ویژوالیزاسیون داده در سطح حرفهای

ggplot2امکان ساخت نمودارهای پیچیده، زیبا و قابل انتشار در مجلات علمی را فراهم میکند.- مناسب برای تولید اینفوگرافیکهای حرفهای و گزارشهای تحقیقاتی

3. تمرکز بر آمار و تحلیل علمی

- R از ابتدا برای آمار طراحی شده است.

- امکان انجام آزمونهای آماری پیچیده (ANOVA، MANOVA، GLM، Mixed Models) با دستورات کوتاه

4. محبوب در محیطهای آکادمیک

- بسیاری از مقالات علمی در رشتههای پزشکی، روانشناسی، علوم اجتماعی و اقتصاد با R نوشته میشوند.

- R Markdown امکان تولید مستندات ترکیبی (کد + متن + نمودار) را فراهم میکند.

⚠️ معایب:

- یادگیری پیچیدهتر نسبت به پایتون (نحو غیرمعمول)

- اکوسیستم محدودتر در حوزههایی مانند وب، امنیت یا اتوماسیون

- سرعت پایین در پردازش دادههای حجیم

- جامعه کاربری کوچکتر نسبت به پایتون

🎯 بهترین کاربردها:

- تحلیلهای آماری پیچیده

- تحقیقات دانشگاهی و پایاننامهها

- تحلیل سریهای زمانی (Time Series)

- تولید گزارشهای علمی و اینفوگرافیک

🔹 1.3. جولیا (Julia) — سرعت C، راحتی پایتون

🏆 وضعیت در سال 2025:

Julia در سالهای اخیر به عنوان نسل جدید زبانهای علمی مطرح شده است. در 2025، Julia به یک انتخاب جدی برای پروژههایی تبدیل شده که سرعت و کارایی در اولویت هستند.

✅ دلایل محبوبیت Julia:

1. سرعت بسیار بالا

- Julia یک زبان Just-In-Time (JIT) است که کد را به صورت پویا کامپایل میکند.

- عملکرد آن به زبانهای سطح پایین مانند C و Fortran نزدیک است.

- بدون نیاز به نوشتن کد C برای بهینهسازی.

2. طراحی برای محاسبات عددی

- از ابتدا برای محاسبات علمی، مهندسی و مالی طراحی شده است.

- پشتیبانی ذاتی از ماتریسها، بردارها و عملیات خطی.

3. کتابخانههای تخصصی قدرتمند

- DifferentialEquations.jl: برای حل معادلات دیفرانسیل

- Flux.jl: یادگیری ماشین و یادگیری عمیق

- Plots.jl: تجسم داده

- DataFrames.jl: کار با دادههای ساختاریافته

4. قابلیت ترکیب با زبانهای دیگر

- امکان فراخوانی مستقیم کد Python، R و C از داخل Julia

- یکپارچهسازی با Pandas و NumPy ممکن است.

⚠️ معایب:

- جامعه کاربری کوچک نسبت به پایتون و R

- مستندات محدودتر و کتابهای آموزشی کمتر

- کمتر در صنعت استفاده میشود (هنوز در مرحله رشد)

- کمترین درصد استخدام در مقایسه با پایتون

🎯 بهترین کاربردها:

- شبیهسازیهای فیزیکی و مهندسی

- مدلسازی مالی پیچیده (مانند ارزشگذاری اختیار معامله)

- محاسبات عددی سنگین

- پروژههایی که نیاز به سرعت بالا دارند

🔹 جدول مقایسه جامع: پایتون، R و Julia

| ویژگی | پایتون | R | Julia |

|---|---|---|---|

| سرعت اجرا | متوسط | پایین | بسیار بالا |

| یادگیری | آسان | متوسط | متوسط |

| اکوسیستم | عالی | خوب | در حال رشد |

| تحلیل آماری | خوب | عالی | خوب |

| یادگیری ماشین | عالی | خوب | خوب |

| ویژوالیزاسیون | خوب | عالی (ggplot2) | خوب |

| کاربرد صنعتی | بسیار بالا | متوسط | پایین |

| کاربرد آکادمیک | بالا | بسیار بالا | رو به افزایش |

| جامعه کاربری | بسیار بزرگ | بزرگ | کوچک |

| مناسب برای LLMها | عالی | ضعیف | متوسط |

🔹 چگونه زبان مناسب را انتخاب کنیم؟

انتخاب زبان باید بر اساس نیاز پروژه، تیم و زیرساخت باشد.

✅ سناریوهای پیشنهادی:

| سناریو | زبان پیشنهادی | توضیح |

|---|---|---|

| تحلیل داده و هوش تجاری | پایتون | اکوسیستم گسترده، یادگیری آسان، یکپارچهسازی با BI |

| پروژههای یادگیری ماشین صنعتی | پایتون | پشتیبانی از PyTorch/TensorFlow، MLOps |

| مقاله علمی یا پایاننامه | R | ggplot2، تحلیل آماری، R Markdown |

| تحلیل سری زمانی مالی | R یا Julia | R برای آمار، Julia برای سرعت |

| شبیهسازی فیزیکی یا مهندسی | Julia | سرعت بالا، محاسبات عددی |

| پروژه تیمی با افراد غیرفنی | پایتون | سادگی و خوانایی بالا |

| مدلهای LLM و RAG | پایتون | ابزارهای LangChain، Hugging Face |

🔚 نتیجهگیری: آینده چه زبانی را میطلبد؟

- پایتون در سال 2025 همچنان انتخاب اول برای اکثر پروژههای علوم داده خواهد بود. انعطافپذیری، اکوسیستم غنی و پشتیبانی صنعتی آن بیرقیب است.

- R در حوزههای تخصصی — بهویژه تحقیقات علمی و آمار — جایگاه محکمی دارد و جای خود را نخواهد داد.

- Julia به تدریج در حال ورود به صحنه است و برای پروژههایی که سرعت و کارایی در اولویت هستند، یک انتخاب هوشمندانه است.

💡 توصیه نهایی:

- اگر تازه وارد حوزه داده شدهاید: پایتون شروع کنید.

- اگر در حوزه آمار یا تحقیقات کار میکنید: R را یاد بگیرید.

- اگر با محاسبات سنگین سروکار دارید: Julia را امتحان کنید.

📌 پیشنهاد عملی: ترکیب زبانها در یک پایپلاین

در پروژههای پیشرفته، میتوان از چند زبان استفاده کرد:

# در پایتون: پردازش اولیه داده

import pandas as pd

df = pd.read_csv("data.csv")

# فراخوانی کد R برای تحلیل آماری

import rpy2.robjects as ro

from rpy2.robjects import pandas2ri

pandas2ri.activate()

ro.globalenv['df'] = df

ro.r('''

library(tidyverse)

result <- df %>% summarise(mean_val = mean(value))

''')

# فراخوانی Julia برای محاسبات سنگین

from julia import Main

Main.include("heavy_calc.jl")

result = Main.run_simulation(df.values)

این روش (Polyglot Data Science) در سازمانهای پیشرفته رایج است.

🔍 سوالات متداول (FAQ)

۱. آیا میتوانم فقط یک زبان یاد بگیرم؟

بله. برای شروع، پایتون کافی است.

۲. آیا Julia جایگزین پایتون میشود؟

نه در کوتاهمدت. Julia مکمل است، نه جایگزین.

۳. کدام زبان بیشترین فرصت شغلی دارد؟

پایتون بدون شک بیشترین تقاضا را دارد.

۴. آیا میتوانم با R در شرکتهای فناوری کار کنم؟

کمتر. بیشتر در بانکها، شرکتهای دارویی و دانشگاهها استفاده میشود.

محیطهای توسعه و پلتفرمهای علوم داده در سال 2025: از VS Code تا Databricks — راهنمای جامع و حرفهای

در دنیای پویای علوم داده، انتخاب محیط توسعه (IDE) و پلتفرم مناسب میتواند تفاوت چشمگیری بین یک پروژه موفق و یک پروژه شکست خورده ایجاد کند. دیگر فقط نوشتن کد کافی نیست — بلکه باید بتوانید به صورت کارآمد، یکپارچه و مقیاسپذیر کار کنید.

در سال 2025، محیطهای توسعه و پلتفرمهای داده به سمت یکپارچهسازی عمیق، هوش مصنوعی درونساختاری، و پشتیبانی از کار تیمی و ابری حرکت کردهاند. در این مقاله، به بررسی بهترین IDEها، محیطهای تعاملی و پلتفرمهای ابری در حوزه علوم داده میپردازیم.

🔹 چرا محیط توسعه در علوم داده مهم است؟

یک دیتا ساینتیست حرفهای فقط با یک ویرایشگر ساده کار نمیکند. او به یک محیط یکپارچه نیاز دارد که:

- امکان اکتشاف داده (Exploratory Data Analysis) را فراهم کند

- کد، متن، و نمودار را در کنار هم نمایش دهد

- با کنترل نسخه (Git)، مدلسازی و استقرار (Deployment) یکپارچه باشد

- قابلیت کار تیمی و اشتراکگذاری داشته باشد

در ادامه، بهترین ابزارها را در سه دسته تقسیم میکنیم:

- محیطهای توسعه (IDEs)

- محیطهای تعاملی (Interactive Notebooks)

- پلتفرمهای ابری (Cloud Platforms)

🔹 2.1. VS Code — سبک، سریع و انعطافپذیر

🏆 وضعیت در سال 2025:

Visual Studio Code (VS Code) تبدیل به محبوبترین IDE در دنیای علوم داده شده است. بر اساس گزارش Stack Overflow و JetBrains، بیش از 70% دیتا ساینتیستها از VS Code استفاده میکنند.

✅ دلایل موفقیت VS Code:

1. افزونههای قدرتمند و تخصصی

- Python Extension: پشتیبانی از IntelliSense، دیباگ، و virtual environments

- Jupyter: اجرای مستقیم سلولهای Jupyter در VS Code

- GitHub Copilot: هوش مصنوعی برای تولید کد خودکار (در سال 2025 با دقت بالاتر)

- Pylance: تحلیل کد هوشمند و تشخیص خطاها

- Remote Development: کار روی سرورهای ابری، Docker یا WSL بدون تغییر محیط

2. یکپارچگی عالی با Git و GitHub

- مشاهده تفاوتها (diff)، کامیت، و برچسبگذاری درون محیط

- ادغام با GitHub Issues و Pull Requests

- پشتیبانی از Code Spaces (محیط توسعه ابری)

3. سبک و سریع

- در مقایسه با PyCharm یا RStudio، مصرف منابع کمتری دارد

- مناسب برای سیستمهای با منابع محدود

4. پشتیبانی از چندین زبان

- پایتون، R، Julia، SQL، Markdown، JSON و غیره

🔧 مثال عملی: تنظیم VS Code برای علوم داده

- نصب افزونههای:

- Python

- Jupyter

- Pylance

- GitHub Copilot

- ایجاد محیط مجازی:

python -m venv venv source venv/bin/activate # یا venv\Scripts\activate در ویندوز - باز کردن یک فایل

.ipynbو اجرای سلولها در VS Code

⚠️ معایب:

- برای کاربران تازهکار، تنظیمات اولیه ممکن است پیچیده باشد

- نیاز به نصب دستی افزونهها

🎯 بهترین کاربردها:

- توسعه مدلهای یادگیری ماشین

- اتوماسیون پردازش داده

- پروژههای تیمی با کنترل نسخه

- کار در محیطهای ابری (با Remote Development)

🔹 2.2. JupyterLab / Notebooks — استاندارد طلایی اکتشاف داده

🏆 وضعیت در سال 2025:

Jupyter Notebook و JupyterLab همچنان استاندارد طلایی برای اکتشاف داده (EDA)، آزمایش ایدهها و اشتراکگذاری نتایج هستند.

✅ ویژگیهای کلیدی:

1. اجرای تعاملی کد (Interactive Execution)

- امکان اجرای کد به صورت سلولبهسلول

- مشاهده فوری نتایج، نمودارها و جداول

- مناسب برای تست سریع فرضیهها

2. ترکیب کد، متن و نمودار (Storytelling)

- استفاده از Markdown برای توضیحات

- تولید مستندات یکپارچه (Code + Narrative + Visualization)

- ایدهآل برای گزارشهای تحقیقاتی و ارائه به ذینفعان

3. پشتیبانی از چندین زبان

- پایتون، R، Julia، Scala، SQL و غیره

- امکان ترکیب زبانها در یک نوتبوک

4. یکپارچهسازی با ابزارهای دیگر

- در VS Code: اجرای نوتبوکها بدون تغییر محیط

- در Databricks و Google Colab: نسخههای ابری Jupyter

🔧 مثال عملی: ساخت یک نوتبوک حرفهای

# سلول 1: توضیحات

"""

## تحلیل فروش ماهانه

در این بخش، دادههای فروش از فایل اکسل خوانده میشود و یک نمودار ایجاد میشود.

"""

# سلول 2: کد

import pandas as pd

import matplotlib.pyplot as plt

df = pd.read_excel("sales.xlsx")

df.plot(x="Month", y="Revenue", kind="bar")

plt.title("فروش ماهانه")

plt.show()

⚠️ معایب:

- عدم مناسب بودن برای توسعه کد تولیدی (Production Code)

- مشکلات نسخهبندی (فایلهای

.ipynbبه صورت JSON ذخیره میشوند) - عدم قابلیت تست واحد (Unit Testing) به راحتی

🎯 بهترین کاربردها:

- اکتشاف داده (EDA)

- آموزش و تدریس

- ارائه نتایج به مدیران

- پروژههای تحقیقاتی

🔹 2.3. پلتفرمهای ابری — آینده علوم داده

در سال 2025، کار در محیط ابری دیگر یک گزینه نیست، بلکه یک ضرورت است. پلتفرمهای ابری امکان مقیاسپذیری، امنیت، و همکاری تیمی را فراهم میکنند.

✅ بهترین پلتفرمهای ابری در 2025:

1. Databricks — پلتفرم اول برای دادههای کلان و ML

- مبتنی بر Apache Spark برای پردازش دادههای حجیم

- Delta Lake: ذخیرهسازی داده با قابلیت نسخهبندی و ACID

- MLflow: مدیریت چرخه حیات مدل (ML Lifecycle)

- Unity Catalog: مدیریت داده و امنیت در سطح Enterprise

- Notebooks یکپارچه با Git و CI/CD

🎯 مناسب برای: سازمانهای بزرگ، پروژههای Big Data، تیمهای ML

2. Snowflake — معماری مدرن داده

- جداسازی محاسبات و ذخیرهسازی: مقیاسپذیری خودکار

- Zero Management: بدون نیاز به مدیریت سرور

- Data Sharing: اشتراکگذاری داده با شرکای تجاری بدون کپی

- Snowpark: اجرای کد پایتون/SQL در سمت سرور

- Integrations: یکپارچه با Tableau، Power BI، و ابزارهای ETL

🎯 مناسب برای: شرکتهای مالی، بانکها، و سازمانهایی که به دنبال Data Cloud هستند

3. AWS SageMaker — راهحل جامع هوش مصنوعی

- نوتبوکهای ابری با GPU/TPU

- AutoML: ساخت مدل بدون نیاز به کدنویسی

- Model Training & Deployment: آموزش و استقرار مدل در یک محیط

- Ground Truth: برچسبگذاری داده

- Feature Store: مدیریت ویژگیها

🎯 مناسب برای: تیمهایی که در اکوسیستم AWS هستند

4. Google Cloud Vertex AI

- یکپارچهسازی با BigQuery: تحلیل داده در مقیاس

- Vertex Pipelines: ایجاد خط لوله MLOps

- Vertex AI Workbench: نوتبوکهای ابری با JupyterLab

- Hyperparameter Tuning: بهینهسازی خودکار مدل

🎯 مناسب برای: سازمانهایی که از GCP استفاده میکنند

5. Azure Machine Learning

- یکپارچه با Power BI و Office 365

- Designer: ایجاد مدل بدون کدنویسی

- MLflow و AutoML

- Azure Databricks: یکپارچهسازی با Databricks

🎯 مناسب برای: سازمانهای ایرانی و بینالمللی که از اکوسیستم مایکروسافت استفاده میکنند

🔹 جدول مقایسه پلتفرمهای ابری

| پلتفرم | محاسبات | ذخیرهسازی | ML | MLOps | بهترین کاربرد |

|---|---|---|---|---|---|

| Databricks | Spark | Delta Lake | ✔️ | MLflow | Big Data، ML Enterprise |

| Snowflake | Separated | Cloud | ✔️ | Snowpark | تحلیل داده، Data Cloud |

| SageMaker | SageMaker Instances | S3 | ✔️ | SageMaker Pipelines | AI/ML در AWS |

| Vertex AI | Cloud Run | BigQuery | ✔️ | Vertex Pipelines | تحلیل در GCP |

| Azure ML | Azure VMs | Blob Storage | ✔️ | Azure Pipelines | سازمانهای مایکروسافتی |

🔹 استراتژی انتخاب محیط مناسب

✅ برای تیمهای کوچک و استارتاپها:

- VS Code + Jupyter + GitHub + Google Colab

- هزینه پایین، یادگیری آسان، مقیاسپذیری متوسط

✅ برای شرکتهای متوسط:

- VS Code + Databricks یا Snowflake + MLflow

- یکپارچهسازی، امنیت، و قابلیت گزارشگیری

✅ برای سازمانهای بزرگ (Enterprise):

- Databricks + Unity Catalog + MLflow + CI/CD

- مدیریت داده، امنیت، و MLOps صنعتی

🔚 نتیجهگیری: آینده چه محیطی را میطلبد؟

- VS Code در سال 2025 همچنان بهترین IDE برای دیتا ساینتیستها خواهد بود.

- JupyterLab به عنوان ابزار اکتشاف داده جای خود را نخواهد داد، اما باید با ابزارهای تولیدی یکپارچه شود.

- پلتفرمهای ابری (Databricks، Snowflake، SageMaker و …) به استاندارد صنعتی تبدیل شدهاند.

💡 توصیه نهایی:

- برای یادگیری: Jupyter + VS Code

- برای پروژههای شخصی: Google Colab

- برای کار تیمی: Databricks یا Snowflake

- برای MLOps: SageMaker، Vertex AI یا Azure ML

📌 پیشنهاد عملی: یک محیط یکپارچه برای تیم داده

# معماری پیشنهادی برای یک تیم داده در 2025

IDE: VS Code (با افزونههای Python، Jupyter، Copilot)

Version Control: GitHub

Cloud Platform: Databricks (یا Snowflake)

MLOps: MLflow + GitHub Actions

Visualization: Power BI یا Tableau

🔍 سوالات متداول (FAQ)

۱. آیا باید بین VS Code و Jupyter انتخاب کنم؟

نه. آنها مکمل هم هستند. از Jupyter برای EDA و VS Code برای توسعه کد استفاده کنید.

۲. آیا میتوانم بدون پلتفرم ابری کار کنم؟

برای پروژههای کوچک بله، اما برای مقیاسپذیری و امنیت، ابر ضروری است.

۳. کدام پلتفرم برای شرکتهای ایرانی مناسبتر است؟

Databricks و Azure ML به دلیل پشتیبانی از فارسی و اکوسیستم مایکروسافت محبوبتر هستند.

۴. آیا Copilot واقعاً مفید است؟

بله، به ویژه برای تولید کد اولیه، مستندسازی و رفع خطا

عالی! متن شما از نظر محتوایی بسیار خوب و بهروز است. در ادامه یک نسخه ویرایششده و حرفهایتر از بخش ۳. کتابخانههای یادگیری ماشین و یادگیری عمیق ارائه میدهم که برای استفاده در گزارشها، ارائهها یا مقالات فنی مناسبتر باشد:

۳. کتابخانههای یادگیری ماشین و یادگیری عمیق

۳.۱. Scikit-learn – پایه و اساس یادگیری ماشین کلاسیک

Scikit-learn همچنان بهعنوان یکی از پایدارترین و کاربرپسندترین کتابخانهها در حوزه یادگیری ماشین کلاسیک شناخته میشود. این کتابخانه با ارائه پیادهسازیهای استاندارد و بهینه از الگوریتمهای سنتی، انتخاب اول برای توسعهدهندگان و دانشمندان داده است.

از جمله قابلیتهای کلیدی آن میتوان به موارد زیر اشاره کرد:

- رگرسیون خطی و لجستیک برای مسائل پیشبینی عددی و طبقهبندی دودویی.

- درخت تصمیم (Decision Trees) و جنگل تصادفی (Random Forest) برای مدلسازی غیرخطی و تفسیرپذیر.

- خوشهبندی K-Means برای گروهبندی دادههای بدون برچسب در حوزه یادگیری بدون نظارت.

Scikit-learn با ترکیب سادگی، مستندات عالی و یکپارچگی بالا با اکوسیستم علم داده پایتون (مانند NumPy، Pandas و Matplotlib)، همچنان ستون فقرات پروژههای یادگیری ماشین در مراحل اولیه توسعه و پروتایپسازی است.

۳.۲. TensorFlow و PyTorch – دو ستون اصلی یادگیری عمیق

در حوزه یادگیری عمیق (Deep Learning)، دو کتابخانه TensorFlow و PyTorch به عنوان رهبران بازار شناخته میشوند، هر کدام با نقاط قوت منحصربهفرد خود.

-

PyTorch (توسط Meta توسعهیافته):

به دلیل ساختار پویای محاسباتی (Dynamic Computation Graph) و رابط کاربری شفاف، پیشتاز جامعه تحقیقاتی و آکادمیک است. انعطافپذیری بالا، پشتیبانی عالی از GPU و یکپارچگی با Python، آن را به انتخاب اول در مقالات و آزمایشهای جدید تبدیل کرده است. -

TensorFlow (توسط Google توسعهیافته):

با تمرکز بر مقیاسپذیری و استقرار در محیطهای تولیدی (Production)، ابزارهای قدرتمندی مانند TensorFlow Serving، TensorFlow Lite و TensorBoard ارائه میدهد. این ویژگیها آن را به گزینهای ایدهآل برای سیستمهای صنعتی و سرویسهای مبتنی بر مدل تبدیل کرده است.

راستای روند ۲۰۲۵: با بهبود ابزارهای استقرار مانند TorchServe و PyTorch Lightning، PyTorch به تدریج در محیطهای تولیدی نیز سهم بازار را افزایش میدهد و فاصله با TensorFlow را کاهش میدهد.

۳.۳. Hugging Face Transformers – انقلابی در پردازش زبان طبیعی (NLP)

کتابخانه Transformers شرکت Hugging Face به سرعت به استاندارد صنعتی در حوزه پردازش زبان طبیعی (NLP) و مدلهای زبانی بزرگ (LLMs) تبدیل شده است.

این کتابخانه دسترسی آسان به صدها مدل پیشآموزشدیده مبتنی بر معماری Transformer را فراهم میکند، از جمله:

- BERT و نسخههای بهبودیافته آن (RoBERTa, DistilBERT)

- GPT (از جمله GPT-2 و مدلهای باز مبتنی بر GPT-3)

- LLaMA (و LLaMA2/3 از Meta)

- T5, Bloom, و سایر مدلهای چندمنظوره

کاربردهای کلیدی:

- Fine-tuning سریع مدلها برای مسائل خاص (مانند طبقهبندی متن، استخراج موجودیت)

- توسعه چتباتهای هوشمند

- خلاصهسازی خودکار متن (Summarization)

- ترجمه ماشینی (Machine Translation)

همچنین، Hugging Face با ارائه مدلهای باز (Open-Source) و پلتفرم مدلهای اشتراکی (Hugging Face Hub)، دموکراتیکتر کردن دسترسی به هوش مصنوعی را تسهیل کرده است.

این سه کتابخانه — Scikit-learn، PyTorch/TensorFlow و Hugging Face — اکوسیستم اصلی توسعه مدلهای هوش مصنوعی در سال ۲۰۲۵ را تشکیل میدهند و دانش عمیق از آنها برای هر متخصص داده ضروری است.

۴. ابزارهای ویژوالیزاسیون و داستانسرایی داده

ویژوالیزاسیون داده تنها به معنای نمایش گرافیکی اطلاعات نیست، بلکه یک ابزار استراتژیک برای درک، تحلیل و انتقال داستان دادهها است. انتخاب ابزار مناسب به اهداف پروژه، سطح تخصص کاربر و زمینه کاربردی (تحلیل تیمی، گزارشدهی مدیریتی یا توسعه محصول) بستگی دارد. در سال ۲۰۲۵، دو دسته ابزار غالب — ابزارهای بصریسازی تجاری و ابزارهای مبتنی بر کدنویسی — نقش کلیدی در زنجیره تحلیل داده ایفا میکنند.

۴.۱. Tableau و Power BI — استانداردهای صنعتی گزارشگیری و داشبورد

Tableau و Microsoft Power BI به عنوان دو ابزار پیشرو در حوزه تحلیل تجاری (Business Intelligence)، به سازمانها کمک میکنند تا دادههای پیچیده را بهصورت بصری، تعاملی و قابل فهم ارائه دهند.

| ویژگی | Tableau | Power BI |

|---|---|---|

| کاربرد اصلی | تحلیل پیشرفته و ویژوالیزاسیون حرفهای | گزارشدهی سازمانی و یکپارچهسازی با اکوسیستم Microsoft |

| قابلیتهای تعاملی | بسیار قوی، مناسب برای کشف داده (Data Discovery) | خوب، با امکانات داشبورد زنده |

| یکپارچهسازی | با منابع داده متنوع (SQL، Hadoop، Google BigQuery و غیره) | عالی با Azure، Excel، SQL Server و سایر محصولات Microsoft |

| هزینه | نسبتاً بالاتر، مناسب سازمانهای بزرگ | مقرونبهصرفه، بهویژه برای کاربران Microsoft 365 |

| یادگیری | شیب یادگیری متوسط تا بالا | شیب یادگیری ملایم، مناسب برای کاربران غیرفنی |

- Tableau برای سناریوهایی که نیاز به ویژوالیزاسیونهای پیچیده و خلاقانه دارند (مانند نقشههای حرارتی پیشرفته، داشبوردهای تعاملی برای تحلیلگران ارشد) بسیار مناسب است.

- Power BI به دلیل یکپارچگی عمیق با Azure و Microsoft 365، انتخاب اول سازمانهایی است که در اکوسیستم Microsoft فعالیت میکنند و به دنبال راهحلی یکپارچه و مقرونبهصرفه هستند.

هر دو ابزار قابلیت اشتراکگذاری داشبوردها، زندهسازی داده (Real-time Dashboards) و امنیت سطح بالا را فراهم میکنند و بهعنوان ابزارهای گزارشدهی سازمانی (Enterprise Reporting) بیرقیب هستند.

۴.۲. کتابخانههای پایتون — قدرت تحلیل و توسعه در یک اکوسیستم باز

در کنار ابزارهای گرافیکی، کتابخانههای پایتون به دانشمندان داده و توسعهدهندگان اجازه میدهند تا ویژوالیزاسیونهای سفارشی، تعاملی و قابل یکپارچهسازی با مدلهای هوش مصنوعی بسازند. این رویکرد برای پروژههای تحقیقاتی، پروتایپسازی سریع و ساخت ابزارهای تخصصی ایدهآل است.

🔹 Matplotlib و Seaborn – پایههای ویژوالیزاسیون علمی

- Matplotlib: کتابخانه پایهای برای رسم نمودارهای 2D و 3D.

- Seaborn: ساختهشده بر پایه Matplotlib، برای ایجاد نمودارهای آماری زیبا و حرفهای (مانند نقشههای همبستگی، نمودارهای توزیع و جعبهای).

- مناسب برای تحلیل اکتشافی داده (EDA) و گزارشهای علمی.

🔹 Plotly و Dash – ویژوالیزاسیون تعاملی و اپلیکیشنهای دادهمحور

- Plotly: قابلیت ایجاد نمودارهای تعاملی (Interactive) مانند نمودارهای سهبعدی، نمودارهای پاشش تعاملی و پنلهای پویا را فراهم میکند.

- Dash (توسعهیافته توسط Plotly): یک فریمورک برای ساخت اپلیکیشنهای تحتوب مبتنی بر پایتون بدون نیاز به دانستن HTML، CSS یا JavaScript.

- مناسب برای: ساخت داشبوردهای هوش مصنوعی، نمایش بلادرنگ خروجی مدلها، شبیهسازیهای دادهمحور.

- قابلیت یکپارچهسازی با Scikit-learn، PyTorch، یا Hugging Face.

🔹 Streamlit – سریعترین راه برای ساخت اپلیکیشنهای تعاملی

- Streamlit یک فریمورک ساده و شگفتانگیز است که با نوشتن چند خط پایتون، امکان ساخت اپلیکیشنهای وب تعاملی را فراهم میکند.

- مزایا:

- یادگیری بسیار آسان.

- ایدهآل برای پروتایپسازی سریع مدلهای ML/DL.

- پشتیبانی از ویجتهای تعاملی (اسلاگر، دکمه، آپلود فایل).

- یکپارچهسازی راحت با مدلهای هوش مصنوعی و کتابخانههای داده.

- مثال کاربردی: ساخت یک ابزار تعاملی برای تست مدل NLP با آپلود متن توسط کاربر و نمایش نتایج به صورت بلادرنگ.

✅ جمعبندی: در حالی که Tableau و Power BI برای گزارشدهی سازمانی و کاربران غیرفنی طراحی شدهاند، کتابخانههای پایتون مانند Streamlit، Plotly و Dash امکان داستانسرایی پیشرفته، سفارشیسازی کامل و یکپارچهسازی با مدلهای هوش مصنوعی را فراهم میکنند. انتخاب بین این دو رویکرد به هدف پروژه و سمتگیری تیم (تحلیلگر، توسعهدهنده یا دانشمند داده) بستگی دارد.

نکته استراتژیک (۲۰۲۵):

ترکیب ابزارهای بصری تجاری با اکوسیستم پایتون (مثلاً استفاده از Power BI برای گزارش نهایی و Streamlit برای پروتایپ مدل) راهکاری هوشمندانه برای دستیابی به هم کارایی و انعطافپذیری است. همچنین، افزایش تقاضا برای داستانسرایی داده (Data Storytelling) نشاندهنده اهمیت طراحی ویژوالیزاسیونهایی است که نه تنها زیبا هستند، بلکه پیام تأثیرگذاری به مدیران و ذینفعان انتقال میدهند.

۵. ابزارهای نوظهور و آیندهدار در عصر هوش مصنوعی

با تسریع روند دیجیتالیسازی و گسترش استفاده از هوش مصنوعی در تمامی لایههای سازمانی، ابزارهای نوینی ظهور کردهاند که نه تنها بهرهوری تیمهای فناوری را افزایش میدهند، بلکه چرخه توسعه مدلهای هوش مصنوعی را نیز حرفهای، مقیاسپذیر و قابل کنترل میکنند. این ابزارها در دو دسته کلی قابل دستهبندی هستند: هوش مصنوعی کمکی (AI-Augmented Development) و MLOps (عملیات هوش مصنوعی).

۵.۱. هوش مصنوعی کمکی در توسعه نرمافزار و تحلیل داده

هوش مصنوعی حالا تنها به عنوان یک مدل پیشبینیکننده محدود نمیشود، بلکه به یک همکار فعال در فرآیند توسعه تبدیل شده است. ابزارهای مبتنی بر مدلهای زبانی بزرگ (LLMs) به توسعهدهندگان، دانشمندان داده و مهندسان داده کمک میکنند تا سریعتر، دقیقتر و با تمرکز بیشتر روی منطق کسبوکار کدنویسی کنند.

🔹 GitHub Copilot و Amazon CodeWhisperer – همکار هوشمند کدنویسی

- GitHub Copilot (بر پایه مدل OpenAI Codex و حالا Copilot X):

- پیشنهاد خطبهخط کد در محیطهای توسعه (مانند VS Code).

- تولید توابع، کامنتهای خودکار، تست واحد و حتی تبدیل توضیحات طبیعی به کد.

- پشتیبانی از بیش از ۳۰ زبان برنامهنویسی.

- Amazon CodeWhisperer:

- تمرکز بر امنیت و یکپارچهسازی با اکوسیستم AWS.

- تشخیص کدهای ناامن یا نقض مجوز (License Violation).

- پیشنهاد کد متناسب با ساختار پروژههای AWS.

✅ تأثیر: این ابزارها تا ۵۰٪ زمان توسعه کد را کاهش میدهند و به ویژه در نوشتن کدهای تکراری، کلاسهای داده و توابع رایج بسیار مؤثرند.

🔹 ChatGPT، Claude، Gemini و مدلهای مشابه – دستیار هوشمند تحلیل و توسعه

این مدلها نقش یک مشاور فنی را ایفا میکنند و در سناریوهای زیر کمک شایانی ارائه میدهند:

- دیباگ کد: تحلیل خطاهای پیچیده و پیشنهاد راهحل.

- نوشتن پرسوجوهای SQL: تبدیل سوالات طبیعی به کوئریهای بهینه و ایمن.

- تولید کد اولیه (Boilerplate Code): ایجاد ساختار اولیه مدلهای ML، APIها یا اسکریپتهای پردازش داده.

- مستندسازی خودکار: تولید مستندات فنی، docstring و گزارشهای تحلیلی.

⚠️ نکته مهم: این ابزارها باید با بازبینی انسانی استفاده شوند، چرا که ممکن است کدهای ناکارآمد، ناامن یا غیرقابل تفسیر تولید کنند.

۵.۲. ابزارهای MLOps – مدیریت حرفهای چرخه حیات مدل هوش مصنوعی

با افزایش تعداد مدلهای هوش مصنوعی در تولید (Production)، نیاز به استانداردسازی، ردیابی و استقرار مقیاسپذیر مدلها اجتنابناپذیر شده است. MLOps (ترکیبی از Machine Learning و DevOps) به عنوان یک چارچوب عملیاتی، این چالشها را با ابزارهای تخصصی مدیریت میکند.

🔹 MLflow – مدیریت آزمایشها، مدلها و چرخه توسعه

- یک چارچوب منبعباز برای ردیابی آزمایشهای یادگیری ماشین.

- قابلیتهای کلیدی:

- ثبت خودکار پارامترها، متریکها و نسخه کد.

- مدیریت مدلها در قالب Model Registry با نسخهبندی و مرحلهبندی (Staging, Production).

- پشتیبانی از همه چارچوبهای ML (Scikit-learn، PyTorch، TensorFlow و غیره).

- ایدهآل برای تیمهایی که به دنبال تکرارپذیری (Reproducibility) و همکاری چندنفره در توسعه مدل هستند.

🔹 DVC (Data Version Control) – نسخهبندی داده و مدل

- مشابه Git، اما برای دادههای بزرگ و مدلهای آموزشدیده.

- امکان ردیابی تغییرات در دادههای آموزشی و ارتباط آن با نتایج مدل.

- یکپارچهسازی با Git برای مدیریت همزمان کد، داده و مدل.

- ضروری برای پروژههایی که تغییر در دیتاست میتواند بر عملکرد مدل تأثیر بگذارد.

🔹 Kubernetes – استقرار مقیاسپذیر و قابل اعتماد مدلها

- سیستم اُرکستراسیون کانتینرها برای مدیریت استقرار (Deployment) و مقیاسدهی خودکار (Auto-scaling) سرویسهای هوش مصنوعی.

- استفاده از Docker + Kubernetes (K8s) امکان استقرار مدلهای ML به صورت میکروسرویس را فراهم میکند.

- مناسب برای محیطهای تولیدی با ترافیک بالا (مانند چتباتها، سیستمهای توصیهگر).

- ابزارهای مکمل: Kubeflow (برای MLOps در K8s)، Seldon Core، KServe.

🔹 سایر ابزارهای نوظهور در MLOps:

- Weights & Biases (W&B): ردیابی آزمایش، ویژوالیزاسیون پیشرفت مدل و همکاری تیمی.

- Great Expectations: اعتبارسنجی داده و تضمین کیفیت داده در خط لولههای ML.

- Evidently AI: نظارت بر عملکرد مدل در تولید ( drift تشخیص تغییر توزیع داده).

چشمانداز آینده (۲۰۲۵ و فراتر)

- ادغام LLMها در خط لوله MLOps: استفاده از مدلهای زبانی برای تولید خودکار گزارشهای عملکرد، تحلیل خطا و پیشنهاد بهبود مدل.

- اتوماسیون کامل چرخه ML: از داده تا استقرار (AutoML + MLOps + CI/CD).

- هوش مصنوعی برای مدیریت هوش مصنوعی: استفاده از مدلهای هوش مصنوعی برای نظارت، دیباگ و بهینهسازی دیگر مدلها (AI-Ops).

جمعبندی

ابزارهای نوظهور در سال ۲۰۲۵ تنها به افزایش سرعت کدنویسی محدود نمیشوند، بلکه چرخه کامل توسعه، آزمایش، استقرار و نظارت بر مدلهای هوش مصنوعی را دگرگون کردهاند. ترکیب هوش مصنوعی کمکی با چارچوبهای MLOps، زمینه را برای ساخت سیستمهای هوشمند قابل اعتماد، مقیاسپذیر و تکرارپذیر فراهم میکند. متخصصان داده در آینده نه تنها باید بتوانند مدل بسازند، بلکه باید بتوانند این مدلها را مدیریت، نظارت و بهروزرسانی کنند — و این دقیقاً جایی است که این ابزارها به یک مزیت رقابتی استراتژیک تبدیل میشوند.

۶. ترندهای کلیدی علوم داده در سال ۲۰۲۵

سال ۲۰۲۵ نقطه عطفی در تحول علوم داده است. با پیشرفت سریع فناوریهای هوش مصنوعی، تغییر نیازهای کسبوکار و افزایش انتظارات از سرعت و دقت تصمیمگیری، حوزه علوم داده دارد از یک فعالیت تخصصی و آزمایشی به یک سیستم عملیاتی، خودکار و یکپارچه تبدیل میشود. در این بخش، چهار روند کلیدی که شکل آینده این حوزه را تعیین خواهند کرد، بررسی میشوند.

۱. حرکت به سمت اتوماسیون کامل چرخه داده

اتوماسیون دیگر محدود به مدلسازی نیست؛ بلکه تمام مراحل چرخه حیات داده — از جمعآوری تا استقرار — در حال خودکارسازی شدن هستند.

- پاکسازی و پیشپردازش داده: ابزارهایی مانند Trifacta، Great Expectations و مدلهای هوش مصنوعی توانایی شناسایی خودکار اشکالات داده (مقادیر گمشده، ناهماهنگی واحد، نویز) و پیشنهاد راهحل را دارند.

- انتخاب ویژگی و مهندسی ویژگی: روشهای مبتنی بر AutoML (مانند FeatureTools یا H2O.ai) بهصورت خودکار ویژگیهای معنادار از دادههای خام میسازند.

- انتخاب مدل و بهینهسازی ابرپارامترها: با ابزارهایی مانند AutoGluon، Google Cloud AutoML و Optuna، فرآیند انتخاب بهترین مدل و تنظیم آن به صورت خودکار انجام میشود.

- تولید کد و مستندات: مدلهای زبانی بزرگ (LLMs) میتوانند اسکریپتهای پایتون، تستهای واحد و حتی گزارشهای تحلیلی را به صورت خودکار تولید کنند.

🔮 چشمانداز: دانشمندان داده دیگر وقت خود را صرف انجام وظایف تکراری نمیکنند، بلکه بر تعریف مسئله، نظارت بر سیستمهای خودکار و تفسیر نتایج استراتژیک تمرکز خواهند کرد.

۲. یکپارچهسازی چرخه حیات داده (End-to-End Integration)

سیستمهای پراکنده و ابزارهای منفرد جای خود را به پلتفرمهای یکپارچه میدهند که تمام مراحل کار را پوشش میدهند.

- خط لوله داده (Data Pipeline)، مدلسازی، استقرار (Deployment) و مانیتورینگ در یک محیط واحد ادغام میشوند.

- ابزارهایی مانند:

- Databricks Lakehouse Platform

- Snowflake + Snowpark ML

- Google Vertex AI

- Azure Machine Learning Studio

— تمام این مراحل را در یک اکوسیستم یکپارچه پشتیبانی میکنند.

- یکپارچهسازی با ابزارهای DevOps (مانند GitLab CI/CD، Jenkins) و MLOps (مانند MLflow، Kubeflow) نیز در حال رشد است.

✅ مزیت: کاهش زمان استقرار مدل از هفتهها به چند ساعت، افزایش قابلیت ردیابی (Traceability) و کاهش خطاهای انسانی ناشی از انتقال بین ابزارها.

۳. افزایش استفاده از مدلهای زبانی بزرگ (LLMs) فراتر از NLP

LLMها دیگر فقط برای پردازش زبان طبیعی نیستند. آنها در حال تبدیل شدن به هسته هوشمندی همهمنظوره در سیستمهای داده هستند.

- کمک به تحلیل داده: تفسیر خودکار نتایج مدل، تولید خلاصه تحلیلی و پاسخ به سوالات تجاری به زبان طبیعی.

- درک دادههای ساختاریافته و ناساختاریافته: ترکیب تحلیل دادههای جدولی (SQL)، متن، تصویر و صوت با استفاده از مدلهای چندوجهی (Multimodal LLMs).

- ساخت دادههای آموزشی مصنوعی (Synthetic Data Generation): تولید دادههای واقعنمایی برای آموزش مدلها بدون نقض حریم خصوصی.

- دستیار هوشمند تیمهای داده: پاسخ به سوالات تخصصی، پیشنهاد بهبود مدل، نوشتن کوئری SQL یا کد پایتون.

- استفاده در حوزههای غیرNLP: پیشبینی سریهای زمانی، خوشهبندی، تشخیص ناهنجاری و حتی برنامهنویسی (AI Coding Agents).

🌐 نکته کلیدی: LLMها به عنوان لایه هوش (Intelligence Layer) بالای سیستمهای داده عمل میکنند و دسترسی به بینشهای پیچیده را برای کاربران غیرفنی ممکن میسازند.

۴. تمرکز فزاینده بر MLOps و عملیات هوش مصنوعی

با افزایش تعداد مدلهای هوش مصنوعی در محیط تولید، مدیریت، نظارت و استقرار مدل از “یک چالش فنی” به “یک ضرورت استراتژیک” تبدیل شده است.

- MLOps دیگر گزینه نیست، بلکه الزام است.

- مؤلفههای کلیدی:

- ردیابی آزمایش (MLflow, Weights & Biases)

- نسخهبندی داده و مدل (DVC, Model Registry)

- استقرار مقیاسپذیر (Kubernetes, Seldon Core)

- مانیتورینگ مدل (Evidently AI, Arize, Fiddler)

- تشخیص Data Drift، Concept Drift و افت عملکرد.

- امنیت و انطباق (Compliance): مدیریت مدلها در راستای استانداردهای GDPR، HIPAA و غیره.

📈 آمار نشان میدهد: تا سال ۲۰۲۵، بیش از ۷۰٪ از سازمانهای فعال در حوزه هوش مصنوعی، خط لوله MLOps رسمی داشته باشند — در مقایسه با کمتر از ۳۰٪ در سال ۲۰۲۰.

جمعبندی: علوم داده در سال ۲۰۲۵ — هوشمند، خودکار و عملیاتی

| روند | تأثیر کلیدی |

|---|---|

| اتوماسیون کامل | کاهش زمان توسعه، افزایش دقت و تمرکز بر مسائل استراتژیک |

| یکپارچهسازی ابزارها | کاهش سردرگمی، افزایش سرعت استقرار و بهبود همکاری تیمی |

| LLMs به عنوان هسته هوشمند | دموکراتیکتر شدن دسترسی به تحلیل داده و هوش مصنوعی |

| تمرکز بر MLOps | اطمینان از قابلیت اعتماد، پایداری و انطباق مدلها در تولید |

✅ نتیجهگیری نهایی: آینده علوم داده در سال ۲۰۲۵، کمتر درباره “چگونه مدل بسازیم” و بیشتر درباره “چگونه هوش مصنوعی را بهعنوان یک سرویس قابل اعتماد و پایدار در کسبوکار اجرا کنیم” است. موفقیت در این عصر به تسلط بر این ترندها و انتقال از نقش “مدلساز” به “مهندس سیستمهای هوشمند” بستگی دارد.

جمعبندی و توصیه نهایی

اگر بخواهیم کل مقاله را در یک جمله خلاصه کنیم:

در سال ۲۰۲۵، تسلط بر یک اکوسیستم یکپارچه (مثل پایتون + کتابخانهها + ابزارهای MLOps) بسیار مهمتر از یادگیری پراکنده ابزارهای مختلف است.

✅ برای شروع:

- زبان اصلی خود را پایتون انتخاب کنید.

- از JupyterLab برای اکتشاف داده استفاده کنید.

- برای ML کلاسیک، Scikit-learn کافی است.

- برای Deep Learning، PyTorch و Hugging Face را یاد بگیرید.

- برای ویژوالیزاسیون، Streamlit و Plotly بهترین انتخابها هستند.

- برای مقیاسپذیری و استقرار، Databricks + MLflow + Kubernetes را یاد بگیرید.